70

Screenshot

最近家里的台式机出问题啦,导致运行在上面的模型无法使用,或多或少都给我造成诸多不便。

虽然自己不是从事 AI 这方面的工作,但是却一直对此挺感兴趣的,家里的台式机上面正好有个之前为了玩游戏购入的显卡。最近实在提不起兴趣玩游戏,所以就让机子跑跑模型。现在机子出问题了,估计一时半会也修不好,于是就想着看能不能在 Mac Studio 上先装个本地的模型顶一段时间。

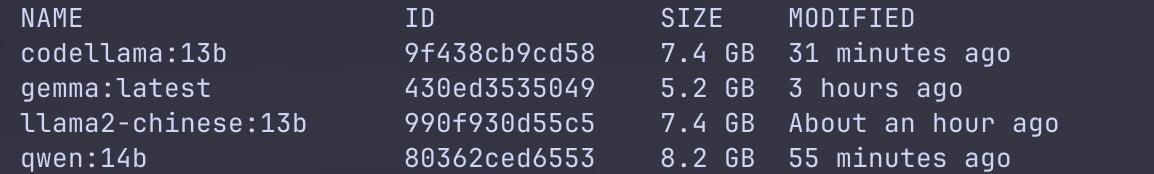

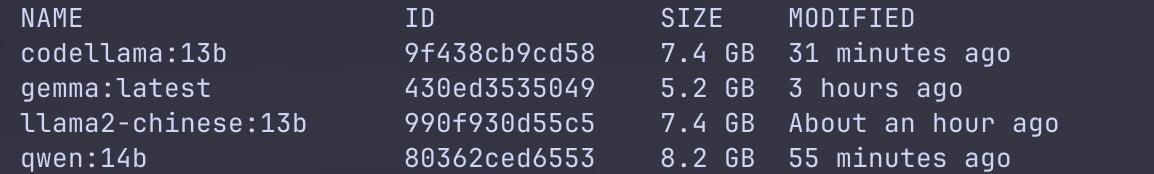

没想到这么一搞,发现在 Mac Studio 上跑 Gemma 和 Qwen 都挺流畅的,当然了,也就跑跑 13b 这样的规格。

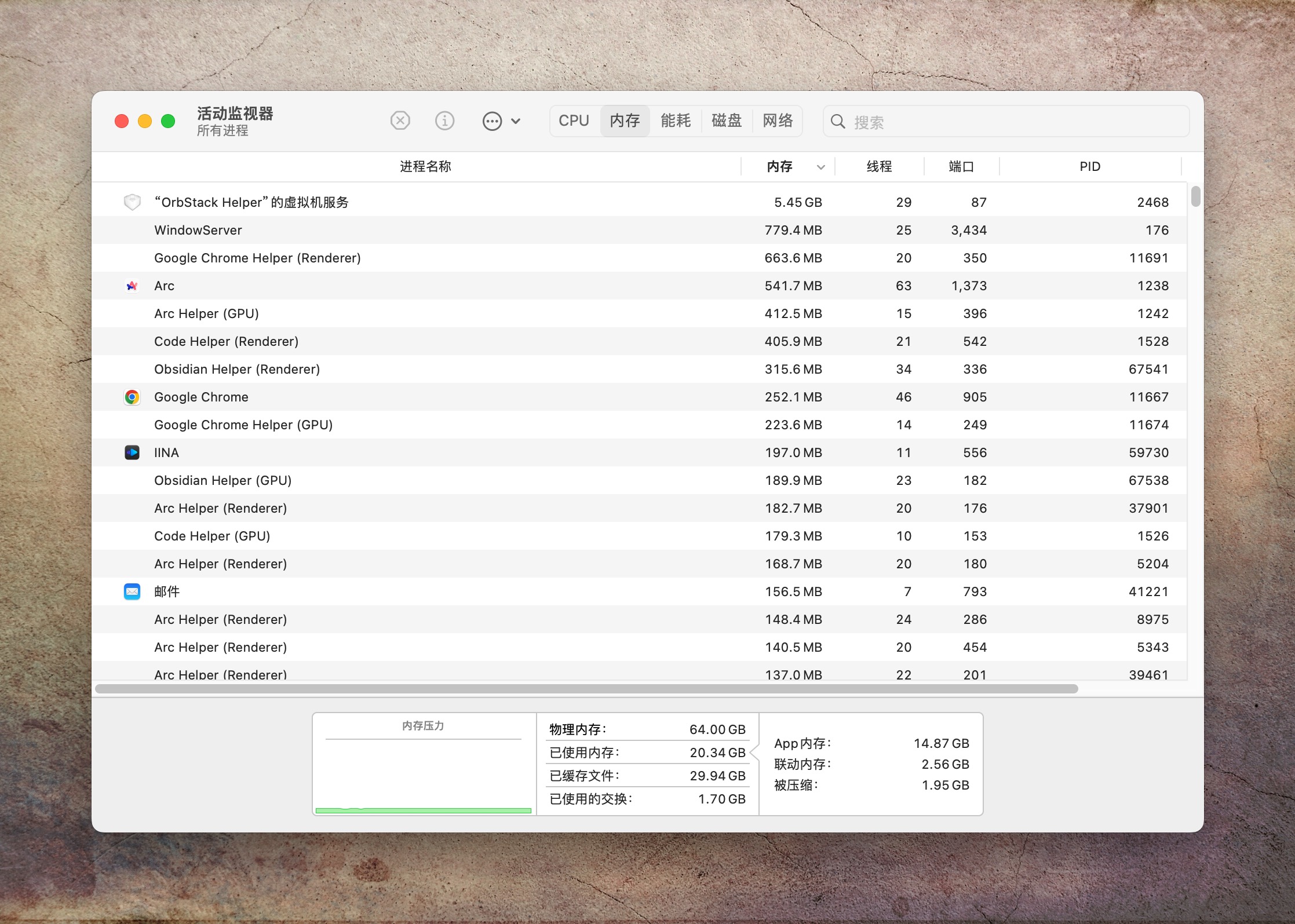

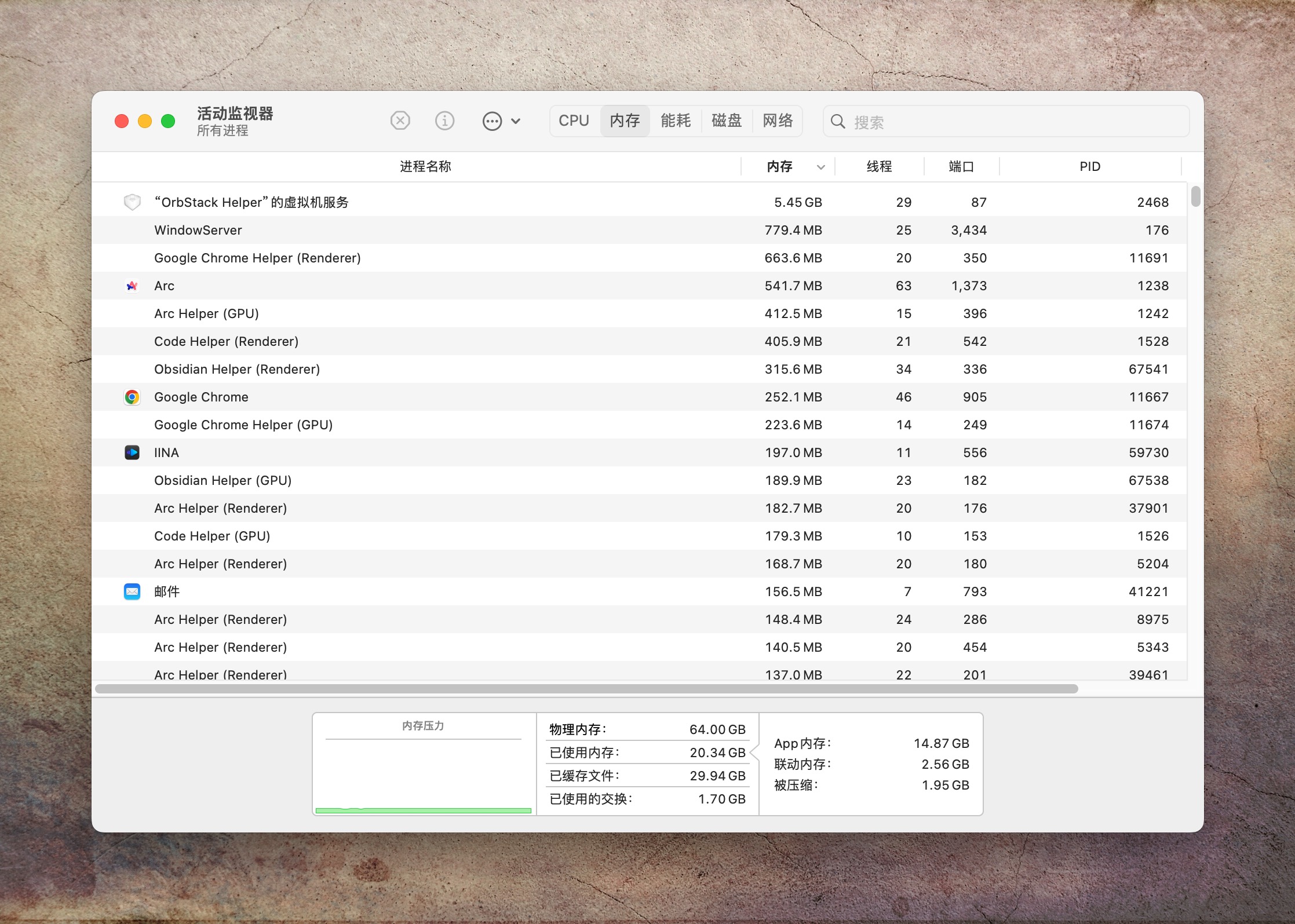

以上是我测试的几个模型,都能在 Mac Studio 上流畅的运行。对了,我的 Mac Studio 配置为 M1Max 64G 内存。

之前机子在我身上算是浪费了,买了差不多两年啦,第一次碰到使用交换内存的情况。正常来我说,我使用的场景,16G 的内存足够了。当时一冲动加到 64G,冲动是魔鬼啊。

手上有 Mac 电脑且没有使用过 Ollama 的话,可以体验一下,一般来说小一点的模型都能运行得非常好。

Ollama 官网 – https://ollama.com/